V tomto tutoriálu vám ukážeme, jak nainstalovat Apache Spark na Ubuntu 20.04 LTS. Pro ty z vás, kteří nevěděli, Apache Spark je rychlý a univerzální clusterový výpočetní systém . Poskytuje API na vysoké úrovni v Javě, Scale a Pythonu a také optimalizovaný engine, který podporuje celkové grafy provádění. Podporuje také bohatou sadu nástrojů vyšší úrovně včetně Spark SQL pro SQL a zpracování strukturovaných informací, MLlib pro stroj učení, GraphX pro zpracování grafů a Spark Streaming.

Tento článek předpokládá, že máte alespoň základní znalosti Linuxu, víte, jak používat shell, a co je nejdůležitější, hostujete svůj web na vlastním VPS. Instalace je poměrně jednoduchá a předpokládá, že běží v účtu root, pokud ne, možná budete muset přidat 'sudo ‘ k příkazům pro získání oprávnění root. Ukážu vám krok za krokem instalaci Apache Spark na server 20.04 LTS (Focal Fossa). Můžete postupovat podle stejných pokynů pro Ubuntu 18.04, 16.04 a jakoukoli jinou distribuci založenou na Debianu, jako je Linux Mint.

Předpoklady

- Server s jedním z následujících operačních systémů:Ubuntu 20.04, 18.04, 16.04 a jakoukoli jinou distribucí založenou na Debianu, jako je Linux Mint.

- Abyste předešli případným problémům, doporučujeme použít novou instalaci operačního systému.

non-root sudo usernebo přístup kroot user. Doporučujeme jednat jakonon-root sudo user, protože však můžete poškodit svůj systém, pokud nebudete při jednání jako root opatrní.

Nainstalujte Apache Spark na Ubuntu 20.04 LTS Focal Fossa

Krok 1. Nejprve se ujistěte, že všechny vaše systémové balíčky jsou aktuální, spuštěním následujícího apt příkazy v terminálu.

sudo apt update sudo apt upgrade

Krok 2. Instalace Java.

Apache Spark vyžaduje ke spuštění Javu, ujistěte se, že máme Javu nainstalovanou v našem systému Ubuntu:

sudo apt install default-jdk

Zkontrolujeme verzi Java pomocí příkazového řádku níže:

java -version

Krok 3. Stáhněte a nainstalujte Apache Spark.

Stáhněte si nejnovější verzi Apache Spark ze stránky pro stahování:

wget https://www.apache.org/dyn/closer.lua/spark/spark-3.0.0/spark-3.0.0-bin-hadoop2.7.tgz tar xvzf spark-3.0.0-bin-hadoop2.7.tgz sudo mv spark-3.0.0-bin-hadoop2.7/ /opt/spark

Další, konfigurace prostředí Apache Spark:

nano ~/.bashrc

Dále přidejte tyto řádky na konec souboru .bashrc, aby cesta mohla obsahovat cestu ke spustitelnému souboru Spark:

export SPARK_HOME=/opt/spark export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin

Aktivujte změny:

source ~/.bashrc

Krok 4. Spusťte samostatný server Spark Master.

Nyní, když jste dokončili konfiguraci prostředí pro Spark, můžete spustit hlavní server:

start-master.sh

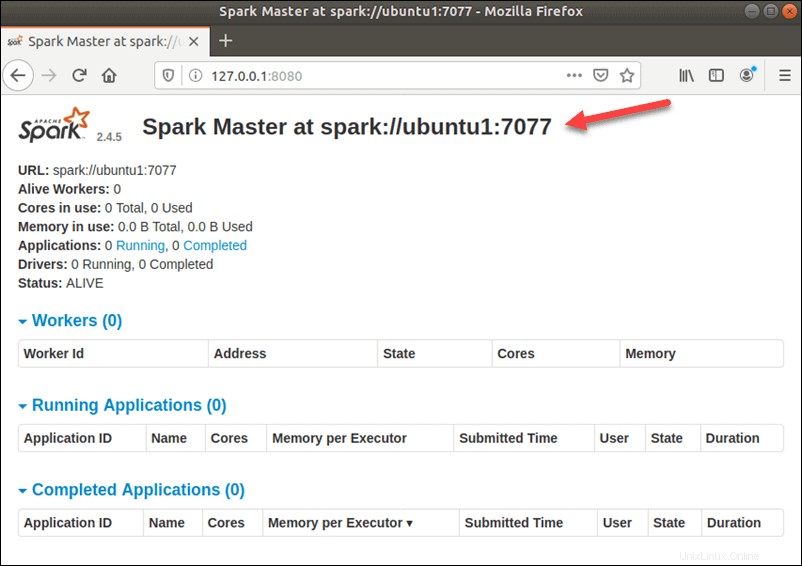

Chcete-li zobrazit uživatelské rozhraní Spark Web, otevřete webový prohlížeč a zadejte adresu IP localhost na portu 8080:

http://127.0.0.1:8080/

V tomto samostatném nastavení s jedním serverem spustíme jeden podřízený server spolu s hlavním serverem. start-slave.sh příkaz se používá ke spuštění procesu Spark Worker:

start-slave.sh spark://ubuntu1:7077

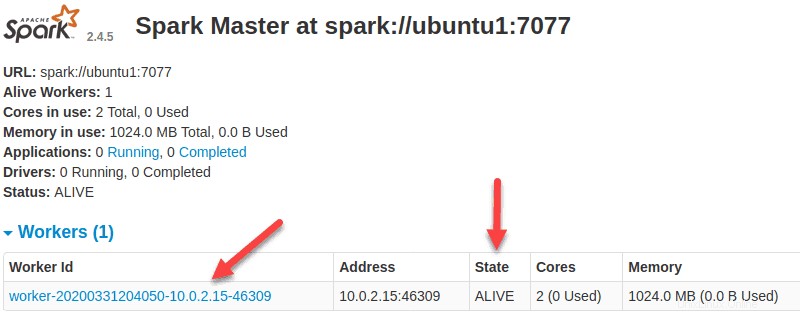

Nyní, když je pracovník spuštěn, a pokud znovu načtete webové uživatelské rozhraní Spark Master, měli byste jej vidět v seznamu:

Poté dokončete konfiguraci a spusťte hlavní a podřízený server, otestujte, zda funguje shell Spark:

spark-shell

Blahopřejeme! Úspěšně jste nainstalovali Apache Spark. Děkujeme, že jste použili tento návod k instalaci Apache Spark na systém Ubuntu 20.04 (Focal Fossa). Pro další pomoc nebo užitečné informace vám doporučujeme navštívit oficiální Web Apache Spark.